Entscheidungsqualität messen: 5 Kennzahlen, die wirklich funktionieren

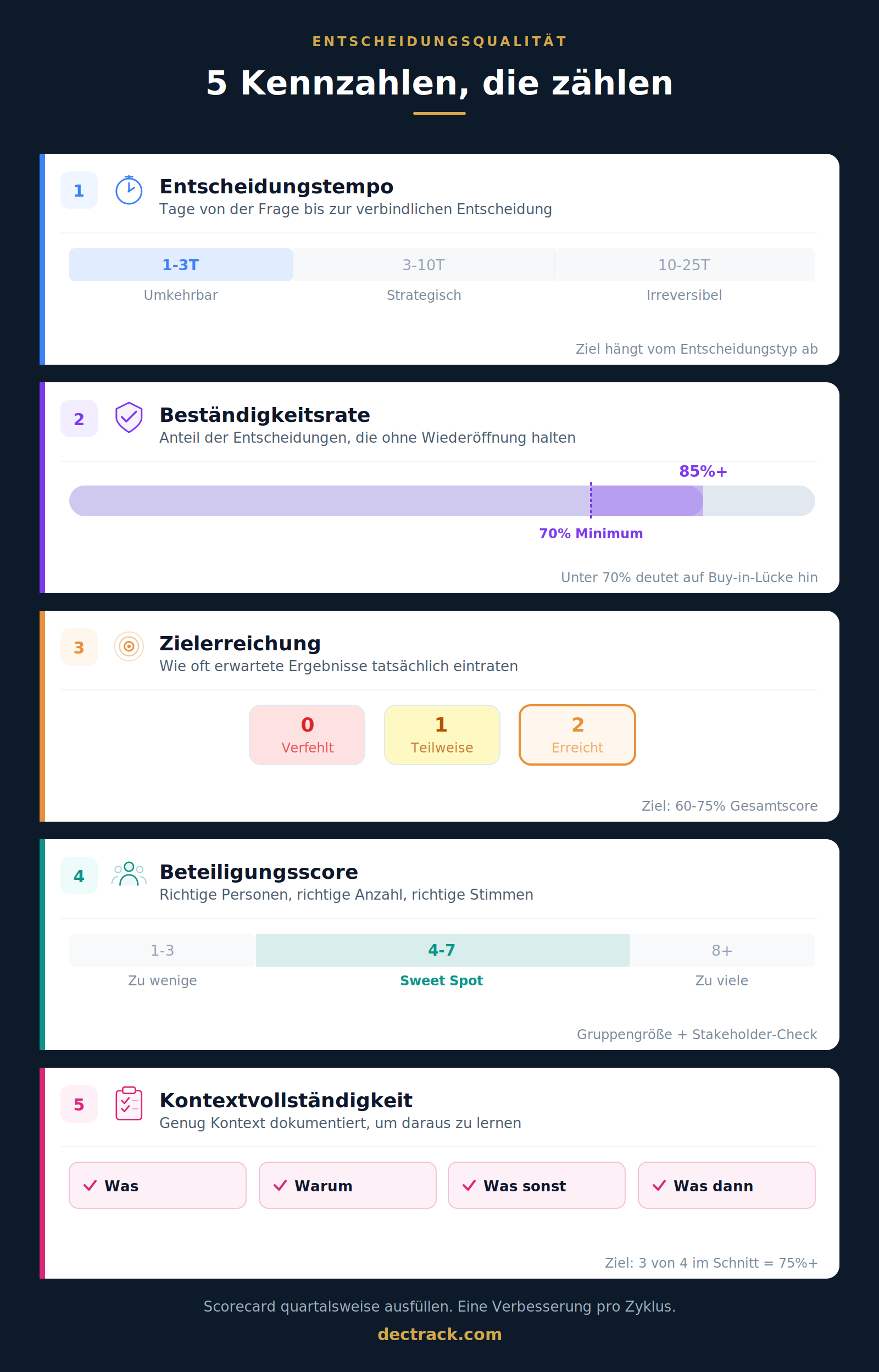

Fünf konkrete, messbare Indikatoren für Entscheidungsqualität: Decision Velocity, Stickiness Rate, Outcome Accuracy, Inclusion Score und Context Completeness. Mit Bewertungsmethoden, durchgerechneten Beispielen und einer fertigen Quartals-Scorecard.

Umsatz wird getrackt. Sprint-Velocity wird gemessen. Kundenzufriedenheit hat einen Score, Onboarding-Conversion einen Prozentsatz. Aber wann hat Ihr Team zuletzt gemessen, ob seine Entscheidungen tatsächlich gut waren?

Falls die Antwort "noch nie" lautet, sind Sie damit nicht allein. Die meisten Teams treffen Hunderte von Entscheidungen pro Jahr und haben keinerlei Daten darüber, wie diese Entscheidungen ausgegangen sind. Sie optimieren alles, nur nicht das, was alles andere antreibt: ihre Entscheidungen.

Dieser Leitfaden gibt Ihnen fünf konkrete, messbare Indikatoren für Entscheidungsqualität. Keine Theorie. Keine abstrakten Prinzipien. Fünf Kennzahlen, die Sie noch diese Woche erheben können, mit konkreten Bewertungsmethoden, durchgerechneten Beispielen und einer fertigen Scorecard, die vage "Wir sollten besser entscheiden"-Gespräche in präzise, umsetzbare Erkenntnisse verwandelt.

Kostenloses Tool zu diesem Artikel:

→ Kostenloses Decision-Log-Tool – Kontext, Optionen, Begründung und nächste Schritte festhalten

Die Messlücke: Warum Entscheidungsqualität unsichtbar bleibt

Teams messen die Ergebnisse ihrer Arbeit obsessiv. Der Umsatz ist gestiegen oder gefallen. Das Feature wurde pünktlich geliefert oder nicht. Der Kunde hat verlängert oder ist abgewandert. Aber das sind Ergebniskennzahlen. Sie sagen Ihnen, was passiert ist, nicht warum.

Das "Warum" lässt sich fast immer auf eine Entscheidung zurückführen. Jemand hat beschlossen, dieses Feature zu priorisieren. Jemand hat entschieden, das Team umzustrukturieren. Jemand hat diesen Anbieter gewählt. Und dennoch: Wenn das Ergebnis enttäuscht, untersuchen Teams selten die Entscheidung selbst. Sie untersuchen die Umsetzung, die Marktbedingungen, das Timing. Die Entscheidung wird als fixer Punkt in der Vergangenheit behandelt, nicht als etwas, das man studieren und verbessern kann.

Das erzeugt einen blinden Fleck. Ein Team, das seine Entscheidungen nie untersucht, wiederholt dieselben Muster, gute wie schlechte, ohne eines davon zu verstehen.

Die Entscheidungsforschung nennt das die Prozess-Ergebnis-Unterscheidung. Das Stanford Decision Quality Framework, entwickelt von Ronald Howard in den 1960er Jahren, macht die Trennung explizit: Eine Entscheidung hat Qualität im Moment, in dem sie getroffen wird, basierend auf dem Prozess, der sie hervorgebracht hat, unabhängig davon, was danach passiert.

Eine sorgfältig durchdachte Entscheidung kann zu einem enttäuschenden Ergebnis führen, weil sich Märkte verschieben, Wettbewerber überraschen oder Annahmen sich trotz solider Datenlage als falsch erweisen. Das ist keine schlechte Entscheidung. Das ist Unsicherheit, die tut, was Unsicherheit eben tut. Umgekehrt kann eine übereilte, uninformierte Entscheidung gelegentlich ein großartiges Ergebnis liefern. Das ist keine gute Entscheidung. Das ist Glück.

Wenn Sie Entscheidungen nur an Ergebnissen messen, bestrafen Sie Teams, die exzellent entschieden haben, aber Pech hatten, und belohnen Teams, die Glück hatten trotz eines schwachen Prozesses. Langfristig optimieren Sie so auf Zufall statt auf Können.

Die fünf Kennzahlen unten messen den Entscheidungsprozess selbst. Sie geben Ihnen eine Methode, aus jeder Entscheidung zu lernen, nicht nur aus denen mit offensichtlichen Ergebnissen.

Die fünf Kennzahlen

Jede Kennzahl enthält: was sie misst, eine konkrete Bewertungsmethode, ein durchgerechnetes Beispiel und Hinweise zur Interpretation. Zusammen ergeben sie ein vollständiges Bild davon, wie Ihr Team entscheidet.

Kennzahl 1: Decision Velocity (Entscheidungsgeschwindigkeit)

Was sie misst: Die verstrichene Zeit von dem Moment, in dem eine Entscheidungsfrage erstmals auftaucht, bis zu dem Moment, in dem eine klare, kommunizierte Entscheidung feststeht.

Hinweis: Unser Leitfaden zu Speed vs. Quality zeigt, wie Sie Entscheidungsgeschwindigkeit mit Guardrails und Timeboxing verbessern. Dieser Abschnitt konzentriert sich darauf, wie Sie sie messen, Baselines etablieren und Muster erkennen.

Wie Sie bewerten:

Für jede Entscheidung notieren Sie zwei Daten: das Datum, an dem das Thema erstmals aufgetaucht ist (in einem Meeting, einem Slack-Thread, einer E-Mail oder auf einer Agenda) und das Datum, an dem die finale Entscheidung kommuniziert wurde. Die Differenz in Kalendertagen ist Ihre Decision Velocity.

Dann kategorisieren Sie jede Entscheidung nach Typ:

| Kategorie | Beschreibung | Zielbereich |

|---|---|---|

| Umkehrbar operativ | Leicht rückgängig zu machen, geringe Tragweite | 1 bis 3 Tage |

| Umkehrbar strategisch | Rückgängig machbar, beeinflusst aber breitere Pläne | 3 bis 7 Tage |

| Irreversibel operativ | Nicht leicht rückgängig, mittlere Tragweite | 5 bis 10 Tage |

| Irreversibel strategisch | Große Festlegung, hohe Tragweite | 10 bis 25 Tage |

Ein Produktteam erfasst 15 Entscheidungen im Januar. Die Auswertung nach Kategorie zeigt:

- Umkehrbare operative Entscheidungen: durchschnittlich 1,5 Tage (gesund)

- Umkehrbare strategische Entscheidungen: durchschnittlich 12 Tage (zu langsam, Ziel sind 3 bis 7)

- Irreversible Entscheidungen: durchschnittlich 6 Tage (möglicherweise zu schnell für High-Stakes-Entscheidungen)

Das Muster ist klar: Dieses Team grübelt über Entscheidungen mittlerer Tragweite, aber eilt durch die großen. Ein verbreitetes und riskantes Muster. Es zu kennen, ist der erste Schritt zur Korrektur.

Worauf Sie achten sollten: Decision Velocity ist am wertvollsten, wenn sie nach Kategorie über die Zeit verfolgt wird. Eine einzelne Zahl ("Unsere Entscheidungen dauern im Schnitt 8 Tage") verbirgt mehr, als sie zeigt.

Kennzahl 2: Stickiness Rate (Beständigkeitsrate)

Was sie misst: Der Prozentsatz der Entscheidungen, die innerhalb eines definierten Zeitraums (typischerweise 90 Tage) in Kraft bleiben, ohne wiedereröffnet, revidiert oder wesentlich verändert zu werden.

Hinweis: Unser Leitfaden zum Verhindern von Wiedereröffnung behandelt Techniken, um Entscheidungen zu stabilisieren. Dieser Abschnitt konzentriert sich auf die Messung des Musters, damit Sie wissen, wo diese Techniken anzuwenden sind.

Wie Sie bewerten:

Am Quartalsende überprüfen Sie alle Entscheidungen des Vorquartals. Für jede markieren Sie:

- Gehalten: Die Entscheidung blieb wie getroffen in Kraft

- Modifiziert: Die Entscheidung wurde angepasst, aber nicht grundlegend verändert

- Wiedereröffnet: Die Entscheidung wurde von Grund auf neu diskutiert oder revidiert

Stickiness Rate = (Gehalten x 1,0 + Modifiziert x 0,5 + Wiedereröffnet x 0) / Gesamtzahl x 100

Gewichtung: Gehalten = 1,0. Modifiziert = 0,5. Wiedereröffnet = 0.

Durchgerechnetes Beispiel:

Ein Team hat in Q1 20 Entscheidungen getroffen. Im Q2-Review:

- 14 gehalten (14 x 1,0 = 14)

- 4 modifiziert (4 x 0,5 = 2)

- 2 wiedereröffnet (2 x 0 = 0)

Gewichtete Stickiness Rate: 16 / 20 = 80%

Benchmark-Bereiche:

| Score | Interpretation |

|---|---|

| 85% und höher | Stark. Entscheidungen landen gut. |

| 70% bis 84% | Normal. Etwas Reibung, die modifizierten/wiedereröffneten Fälle lohnen einen genaueren Blick. |

| Unter 70% | Deutliche Probleme mit Buy-in, Kommunikation oder Dokumentation. |

Worauf Sie achten sollten: Wenn Sie wiedereröffnete Entscheidungen mit dem Grund taggen (neue Information, fehlender Stakeholder, schwache Kommunikation, veränderte Umstände), zeigen sich Muster schnell. Die meisten Teams stellen fest, dass 80% ihrer Wiedereröffnungen auf nur ein bis zwei Ursachen zurückgehen.

Kennzahl 3: Outcome Accuracy (Zielerreichungsgenauigkeit)

Was sie misst: Wie oft das erwartete Ergebnis einer Entscheidung tatsächlich eingetreten ist, bewertet auf einer Drei-Punkte-Skala.

Dies ist die Kennzahl, die Entscheidungsqualität mit realen Ergebnissen verbindet. Sie erfordert auch die meiste Geduld, denn Ergebnisse brauchen Zeit, um sich zu zeigen.

Wie Sie bewerten:

Zum Zeitpunkt der Entscheidung schreiben Sie eine spezifische, testbare Erwartung auf. Nicht "das wird Dinge verbessern", sondern "wir erwarten, dass dies die Support-Tickets innerhalb von 8 Wochen um 20% reduziert." Inklusive Überprüfungsdatum.

Wenn der Überprüfungstermin kommt, bewerten Sie:

| Score | Bedeutung |

|---|---|

| 2 | Erreicht: Ergebnis hat die Erwartung erfüllt oder übertroffen |

| 1 | Teilweise erreicht: Ergebnis ging in die richtige Richtung, blieb aber unter der Erwartung |

| 0 | Verfehlt: Ergebnis ist nicht eingetreten oder ging in die falsche Richtung |

Outcome Accuracy = (Summe aller Scores / maximal möglicher Score) x 100

Durchgerechnetes Beispiel:

Ein Team überprüft 8 Entscheidungen aus Q1 in ihrem Q3-Review:

- 3 Entscheidungen mit Score 2 (erreicht)

- 3 Entscheidungen mit Score 1 (teilweise erreicht)

- 2 Entscheidungen mit Score 0 (verfehlt)

Gesamtscore: 6 + 3 + 0 = 9. Maximal möglich: 8 x 2 = 16.

Outcome Accuracy: 9 / 16 = 56%

Wichtige Nuance: Eine niedrige Outcome Accuracy bedeutet nicht automatisch schlechte Entscheidungen. Ein Team, das mutige Entscheidungen in unsicherem Umfeld trifft, wird naturgemäß mehr Fehlschläge haben. Der Wert dieser Kennzahl liegt nicht in der absoluten Zahl, sondern in den Mustern, die sich über die Zeit zeigen.

Worauf Sie achten sollten: Die Erwartungen, die Sie aufschreiben, sind genauso wichtig wie die Scores. Wenn Erwartungen vage sind ("das wird Dinge verbessern"), können Sie nicht sinnvoll bewerten. Wenn Erwartungen zu präzise sind ("exakt 23,5% Verbesserung"), produzieren Sie unnötige Fehlschläge. Streben Sie spezifisch und realistisch an: eine klare Richtung, eine ungefähre Größenordnung und einen Zeitrahmen.

Kennzahl 4: Inclusion Score (Beteiligungsscore)

Was sie misst: Ob die richtigen Personen an der Entscheidung beteiligt waren, bewertet auf zwei Dimensionen: Gruppengröße und Stakeholder-Abdeckung.

Forschung zu Gruppenentscheidungen zeigt konsistent einen Sweet Spot von 4 bis 7 Personen. Weniger birgt das Risiko blinder Flecken. Mehr verlangsamt den Prozess, ohne die Ergebnisse messbar zu verbessern. Aber die Größe allein reicht nicht. Eine Gruppe von sieben Personen aus derselben Abteilung wird Dinge übersehen, die eine kleinere, diversere Gruppe erkennen würde.

Wie Sie bewerten:

Für jede Entscheidung beantworten Sie zwei Fragen:

Frage 1: War die Gruppengröße angemessen?

- 4 bis 7 aktiv beteiligte Personen: Score 2

- 2 bis 3 Personen (klein, aber angemessen für den Umfang): Score 1

- 1 Person oder 8+ Personen: Score 0

Frage 2: Waren die wesentlichen Stakeholder einbezogen?

Identifizieren Sie, wer vom Ergebnis am stärksten betroffen ist. Waren diese Personen eingebunden?

- Alle wesentlichen Stakeholder einbezogen: Score 2

- Die meisten einbezogen, eine spürbare Lücke: Score 1

- Wesentliche Stakeholder fehlten: Score 0

Inclusion Score pro Entscheidung = (F1 + F2) / 4 x 100

Durchgerechnetes Beispiel:

| Entscheidung | Gruppengröße | Stakeholder | Score |

|---|---|---|---|

| Preisanpassung | 2 (5 Personen) | 2 (Sales, Product, Finance dabei) | 100% |

| Einstellungspriorität | 1 (3 Personen) | 0 (Hiring Manager nicht einbezogen) | 25% |

| Tech-Stack-Wahl | 0 (9 Personen) | 2 (alle relevanten Engineers dabei) | 50% |

| Feature-Priorisierung | 2 (6 Personen) | 1 (Customer Success fehlte) | 75% |

Durchschnittlicher Inclusion Score über alle 10 Entscheidungen: 68%

Worauf Sie achten sollten: Der Inclusion Score ist besonders aufschlussreich im Zusammenspiel mit der Stickiness Rate. Entscheidungen mit niedrigem Inclusion Score werden häufiger wiedereröffnet. Wenn Ihre Daten dieses Muster bestätigen, haben Sie ein starkes Argument für breitere Beteiligung bei bestimmten Entscheidungstypen.

Kennzahl 5: Context Completeness (Kontextvollständigkeit)

Was sie misst: Enthält der Eintrag einer dokumentierten Entscheidung genug Information, damit jemand (auch Ihr zukünftiges Ich) versteht, was entschieden wurde, warum, und was erwartet wird?

Dies ist die Grundlagen-Kennzahl. Ohne sie werden die anderen vier schwierig bis unmöglich zu messen. Sie können die Outcome Accuracy nicht berechnen, wenn Sie nie aufgeschrieben haben, was Sie erwartet haben. Sie können den Inclusion Score nicht bewerten, wenn Sie nicht dokumentiert haben, wer beteiligt war.

Wie Sie bewerten:

Bewerten Sie jede dokumentierte Entscheidung anhand von vier Elementen:

| Element | Vorhanden? | Score |

|---|---|---|

| Die Entscheidung selbst (was gewählt wurde) | Ja/Nein | 1 oder 0 |

| Die Begründung (warum diese Option) | Ja/Nein | 1 oder 0 |

| Betrachtete Alternativen (was sonst zur Auswahl stand) | Ja/Nein | 1 oder 0 |

| Erwartetes Ergebnis mit Zeitrahmen (was soll passieren und bis wann) | Ja/Nein | 1 oder 0 |

Context Completeness = Summe / 4 x 100

Ein Team prüft seine letzten 12 Entscheidungen:

- 3 Einträge enthalten alle vier Elemente (Score: 100%)

- 5 Einträge enthalten die Entscheidung und Begründung, aber keine Alternativen oder erwarteten Ergebnisse (Score: 50%)

- 4 Einträge dokumentieren nur, was entschieden wurde (Score: 25%)

Durchschnittliche Context Completeness: 54%

Das Team erfasst, was es entscheidet, überspringt aber routinemäßig Alternativen und erwartete Ergebnisse. Das bedeutet: Aus Ergebnissen lernen ist schwierig (keine Erwartungen dokumentiert) und vergangene Fehler vermeiden unmöglich (keine Alternativen festgehalten). Die Lösung ist einfach: Zwei Zeilen mehr pro Entscheidungseintrag.

Benchmark-Bereiche:

| Durchschnitt | Interpretation |

|---|---|

| 75% bis 100% | Stark. Ihre Entscheidungsprotokolle sind echte Lerninstrumente. |

| 50% bis 74% | Funktional. Sie erfassen die Basics, aber Begründung oder Alternativen fehlen oft. |

| Unter 50% | Fragil. Die meisten Einträge sagen nur "Wir haben X entschieden" ohne Kontext. |

Worauf Sie achten sollten: Context Completeness korreliert häufig negativ mit der Komplexität des Dokumentationsformats. Teams mit aufwendigen 10-Felder-Vorlagen scoren oft niedriger als Teams mit einem schlichten Vier-Zeilen-Format, weil die aufwendige Vorlage komplett übersprungen wird. Halten Sie es einfach: Was, warum, was sonst noch, was als Nächstes.

Die Decision Quality Scorecard

So kommen alle fünf Kennzahlen in einer quartalsweisen Scorecard zusammen:

| Kennzahl | Gesunder Bereich |

|---|---|

| Decision Velocity | Variiert nach Kategorie (siehe Tabelle oben) |

| Stickiness Rate | 70% und höher |

| Outcome Accuracy | 60 bis 75% |

| Inclusion Score | 65% und höher |

| Context Completeness | 75% und höher |

Erheben Sie diese Kennzahlen quartalsweise. Die absoluten Zahlen sind wichtig, aber der Trend noch wichtiger. Ein Team bei 55% Outcome Accuracy, das Quartal für Quartal steigt, ist in einer besseren Position als ein Team, das bei 65% stagniert.

Das Decision Quality Review: Schritt für Schritt

Die Scorecard entfaltet ihren größten Nutzen in einer strukturierten 30-Minuten-Session. Hier ist ein Format, das funktioniert:

Vorbereitung (5 Minuten vor dem Meeting):

Ziehen Sie Ihr Entscheidungsprotokoll für das Quartal heran. Zählen Sie, wie viele Entscheidungen dokumentiert sind. Notieren Sie offensichtliche Muster, die Ihnen beim Durchsehen auffallen.

Teil 1: Kennzahlen bewerten (10 Minuten)

Gehen Sie jede Kennzahl durch. Sie müssen nicht jede einzelne Entscheidung bewerten. Eine repräsentative Stichprobe von 8 bis 12 Entscheidungen pro Quartal reicht, um Muster zu erkennen.

Teil 2: Muster identifizieren (10 Minuten)

Schauen Sie die Scores gemeinsam an und fragen Sie:

- Welche Kennzahl hat sich verbessert? Was hat sich in unserem Prozess verändert, das dies erklären könnte?

- Welche Kennzahl ist gesunken? Was ist passiert?

- Gibt es bestimmte Entscheidungstypen (Hiring, Produkt, Budget, technisch), bei denen wir konsistent niedriger scoren?

- Korrelieren zwei Kennzahlen? (Niedriger Inclusion Score sagt oft niedrige Stickiness voraus. Niedrige Context Completeness sagt oft niedrige Outcome Accuracy voraus.)

Teil 3: Eine Verbesserung wählen (10 Minuten)

Wählen Sie genau eine Sache, die Sie im nächsten Quartal ändern. Nicht drei Dinge. Keinen neuen Prozess. Eine spezifische, konkrete Änderung. Beispiele:

- "Wir beziehen Finance in jede Entscheidung mit Budgetauswirkung über 5.000 Euro ein."

- "Wir fügen jedem Entscheidungseintrag ein erwartetes Ergebnis hinzu."

- "Wir benennen innerhalb von 48 Stunden einen Decision Owner für alle offenen Punkte."

Eine Verbesserung pro Quartal kumuliert schneller als man denkt. Nach einem Jahr hat Ihr Team vier gezielte Korrekturen an seinem Entscheidungsprozess vorgenommen, jede einzelne gestützt auf echte Daten.

Fünf Fehler, die die Messung von Entscheidungsqualität untergraben

Auch Teams, die sich zur Messung von Entscheidungsqualität bekennen, können ins Stolpern geraten. Dies sind die häufigsten Fallen:

1. Es als Leistungsbewertung behandeln

2. Zu viel auf einmal messen

3. Unrealistische Erwartungen setzen

4. Den Kreislauf nicht schließen

5. Zu früh komplizierte Tools einsetzen

Sechs-Monats-Walkthrough: Wie das in der Praxis aussieht

Um den gesamten Prozess greifbar zu machen, hier ein Durchlauf für ein achtköpfiges Team über die ersten sechs Monate.

Monat 1: Die Erfassungsgewohnheit aufbauen

Das Team beginnt, Entscheidungen in einem gemeinsamen Protokoll festzuhalten. Noch nichts bewerten, nur erfassen: was entschieden wurde, die Begründung und was erwartet wird. Ende des Monats: 14 Einträge. Durchschnittliche Context Completeness: 48%. Die meisten Einträge erfassen die Entscheidung und die Begründung, aber überspringen Alternativen und erwartete Ergebnisse.

Monat 2: Erstes Review

Das Team führt sein erstes 30-Minuten-Review durch und betrachtet 6 Entscheidungen aus Monat eins. Zwei Dinge fallen sofort auf. Erstens: Eine Entscheidung zur Neuorganisation der Support-Rotation brauchte 16 Tage, obwohl sie vollständig umkehrbar war. Niemand war verantwortlich, also wanderte das Thema zwischen drei Meetings. Zweitens: Eine Anbieterentscheidung wurde bereits hinterfragt, weil die Operations-Leitung nicht einbezogen war.

Monat 3: Muster bilden sich

Context Completeness steigt auf 62%. Decision Velocity verbessert sich bei umkehrbaren Entscheidungen (Durchschnitt sinkt von 9 auf 4 Tage), weil klare Zuständigkeit das Meetings-Ping-Pong eliminiert.

Monat 4: Outcome Accuracy kommt ins Spiel

Genug Zeit ist vergangen, um frühe Entscheidungen gegen ihre erwarteten Ergebnisse zu prüfen. Von 8 überprüften Entscheidungen: Outcome Accuracy bei 56%. Beide Fehlschläge betreffen Recruiting.

Monat 5: Kennzahlen-übergreifende Erkenntnis

Das Team bemerkt, dass 3 von 4 wiedereröffneten Entscheidungen (niedrige Stickiness) auch niedrige Inclusion Scores hatten. Der Zusammenhang ist im Nachhinein offensichtlich: Entscheidungen ohne betroffene Stakeholder werden in der Umsetzung angefochten.

Monat 6: Erste quartalsweise Scorecard

Context Completeness: 71%. Stickiness Rate: 78%. Decision Velocity: im Ziel bei umkehrbaren Entscheidungen, noch langsam bei strategischen. Inclusion Score: 64%. Outcome Accuracy: 62%. Keine dieser Zahlen ist spektakulär. Aber jede einzelne liegt höher als vor sechs Monaten. Und das Team hat drei gezielte Prozessverbesserungen vorgenommen, jede gestützt auf echte Daten und jede sichtbar in den Scores reflektiert.

Wann von der Tabelle zum dedizierten Tool wechseln

Eine geteilte Tabelle funktioniert gut für die ersten 30 bis 40 Entscheidungen und die ersten zwei bis drei quartalsweisen Reviews. Danach werden drei Dinge umständlich:

- Filtern und Mustererkennung. Sie wollen "alle Recruiting-Entscheidungen der letzten 6 Monate" oder "alle Entscheidungen mit Inclusion Score unter 50%" sehen. Tabellen können das, aber es erfordert manuellen Aufbau.

- Review-Erinnerungen. Wenn Sie ein erwartetes Ergebnis mit Überprüfungsdatum erfassen, muss etwas Sie erinnern, es tatsächlich zu überprüfen. Tabellen senden keine Erinnerungen.

- Langzeittrends. Zu sehen, wie sich Ihre Scorecard von Quartal zu Quartal entwickelt, erfordert das manuelle Erstellen von Diagrammen.

An diesem Punkt zahlt sich ein dediziertes Tool aus. DecTrack ist genau für diesen Workflow gebaut: Entscheidungen mit Kontext erfassen, Verantwortliche zuweisen, nachverfolgen, wer beteiligt war, Review-Termine setzen und sehen, wie sich Ihre Kennzahlen über die Zeit entwickeln.

Den Kreislauf schließen

Die meisten Teams messen alles an ihrer Arbeit, nur nicht die Entscheidungen, die sie formen. Umsatz, Velocity, Zufriedenheit, Conversion: alles wird getrackt. Aber die Entscheidungen, die diese Zahlen antreiben? Unsichtbar.

Die fünf Kennzahlen in diesem Leitfaden machen Entscheidungsqualität sichtbar. Decision Velocity zeigt, wo Ihr Prozess schnell ist und wo er stockt. Die Stickiness Rate zeigt, ob Entscheidungen landen oder angefochten werden. Outcome Accuracy verbindet Ihre Entscheidungen mit ihren realen Ergebnissen. Der Inclusion Score fängt die fehlenden Stimmen ein, die zu Wiedereröffnungen führen. Context Completeness stellt sicher, dass Sie aus allem anderen lernen können.

Nichts davon ist kompliziert. Nichts davon erfordert spezielle Schulung. Es erfordert eines: die Bereitschaft, mit ehrlicher Neugier auf Ihre Entscheidungen zurückzublicken, die Muster zu finden und jeweils eine kleine Verbesserung vorzunehmen.

Teams, die das tun, bauen eine Art kollektive Entscheidungsintelligenz auf, die sich Quartal für Quartal verstärkt. Jedes Review schärft die nächste Entscheidung. Jedes erkannte Muster beseitigt einen wiederkehrenden blinden Fleck. Und Schritt für Schritt wird aus "Wir glauben, dass wir gute Entscheidungen treffen" ein "Wir wissen es, und hier ist die Scorecard, die es belegt."

Weitere Artikel im DecTrack-Blog

- Speed vs. Quality: Schnellere und bessere Teamentscheidungen (Entscheidungsgeschwindigkeit verbessern mit Guardrails)

- Entscheidungen stabilisieren: Wiedereröffnung verhindern (Techniken für höhere Beständigkeit)

- Aus Entscheidungen lernen: Retrospektiven und Feedback-Schleifen (der Review-Prozess im Detail)

- Decision Tracking: Was es ist und wie Sie starten (die Erfassungsgewohnheit aufbauen)

- Wo leben die Entscheidungen Ihres Teams? Das Problem verstreuter Entscheidungen (warum Kontext verloren geht)

- 9 Entscheidungsfallen, die Teams vermeiden müssen (kognitive Verzerrungen bei Entscheidungen)

DecTrack

2. März 2026